在AI算力竞争日益激烈的当下,一家专注于推理GPU的初创企业曦望,凭借其独特的技术路线和市场策略,迅速崛起为行业焦点。短短一年多时间内,该公司已完成七轮融资,累计金额达40亿元,并在最新一轮融资中以10亿元创下国内该赛道最大单笔融资纪录,估值突破百亿,成为国内首家纯推理GPU领域的独角兽企业。

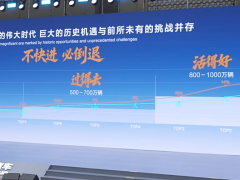

曦望的快速崛起,源于其对AI算力需求结构性变化的精准判断。公司联席CEO王湛指出,随着Agent技术的普及,AI应用场景正从单一对话向复杂任务执行转变,高频、多轮的交互模式导致推理算力需求呈现指数级增长。数据显示,2026年AI推理计算的需求量将达到训练算力的4-5倍,这一趋势彻底颠覆了此前市场对大模型参数量和训练集群规模的关注焦点。

“单位Token成本已成为决定AI应用普及的关键因素。”王湛以海外用户与AI交互产生高额费用为例,强调降低推理成本的技术紧迫性。他表示,当企业从关注模型“能否用”转向“好不好用”和“用不用得起”时,推理算力的性价比优势便凸显出来。这一判断与英伟达在GTC大会上强调“每瓦Token吞吐量”的策略不谋而合,也解释了国内云厂商近期频繁调整算力价格的商业逻辑。

曦望的技术路线堪称激进——完全放弃训练能力,将全部资源投入推理场景优化。其最新发布的启望S3芯片通过裁剪训练相关模块,使单位面积有效算力效率提升5倍以上,目标是将百万Token成本压至一分钱。在架构设计上,S3针对Agent时代的痛点进行了深度定制:计算层通过专用AI Core架构将核心算子利用率提升至接近100%,并支持全链路低精度运算;系统层则成为国内首个采用LPDDR6显存和PCIe Gen6接口的推理GPU,显存容量接近600GB,系统带宽翻倍,有效解决了长上下文记忆的瓶颈问题。

“GPU效能的发挥需要全栈协同。”王湛透露,曦望的硬件和软件均实现100%自研,这使得公司能够基于前沿技术进行深度优化。例如,通过自主开发的仿真验证工具,团队在芯片流片前已完成海量算子的模拟运行,确保一次性流片成功。这种工程化能力在国产GPU企业中极为罕见,也为S3芯片的快速迭代提供了保障。

在生态兼容性方面,曦望选择了“通用架构+自主底层”的平衡路线。公司通过自研代码实现了对CUDA生态99%以上的兼容,既降低了客户迁移成本,又守住了技术自主权。王湛认为,通用计算架构(GPU)比专用架构(ASIC)更能适应Agent时代的多样化需求,而兼容CUDA则是实现商业化的必要条件。

曦望的团队构成堪称“豪华阵容”:董事长徐冰作为商汤联合创始人,负责战略与融资;联席CEO王勇拥有20余年半导体经验,主导芯片研发;王湛则凭借互联网大厂的商业化经验,操盘运营与市场。三位核心成员与400余人的研发团队(占比超80%)形成“六边形战士”网络,核心成员平均行业经验超过15年,来自英伟达、AMD、华为海思等顶尖企业。

为吸引人才,曦望在组织机制上做出大胆创新:设立中国GPU企业中最大的员工持股计划(ESOP)池。王湛表示,这种类似于早期华为、阿里的分享机制,有效激发了团队的战斗力。“只有让人才分享成功,才能打造真正有竞争力的产品。”

面对当前AI资本热潮,曾亲历2000年互联网泡沫的王湛保持清醒。他以ChatGPT用户增长速度为例,指出AI与当年互联网的本质区别:前者正以远超产业革命的速度创造基础价值,需求瓶颈主要来自生产工具而非市场本身。“只要体验提升,需求就会暴涨。”曦望将互联网大厂作为首要目标客户,通过严苛需求打磨产品,计划依托S3的交付能力和生态布局,在算力红海中建立竞争优势。

“AI的本质是分发智能,抹平信息鸿沟。”王湛最后表示,曦望的使命是通过技术突破降低AI使用门槛,让智能真正惠及所有人。这种理念不仅体现在产品设计中,也贯穿于公司的每一个决策环节。