谷歌DeepMind与香港大学联合发布了一项突破性研究,提出名为"草稿纸分块"(Scratchpad Patching,简称SP)的新方法,旨在解决字节级语言模型中长期存在的"补丁滞后"难题。该研究以预印本形式在arXiv平台公开,编号为arXiv:2605.09630,为提升AI模型处理文本的效率与质量提供了全新思路。

传统语言模型依赖分词器将文本切割为词语碎片后处理,但面对生僻词、外语或代码时易出现错误。字节级模型直接以计算机存储的最小单位——字节为处理对象,理论上可兼容所有语言与格式,但字节序列过长导致计算成本激增。为平衡效率与成本,研究人员提出将连续字节打包为"补丁"(patch),以补丁为单位处理文本,但这一方法又引发了新的挑战:模型在预测补丁内部字节时,只能依赖上一个补丁的"旧信息",无法获取当前补丁已处理部分的内容,这种信息滞后被称为"补丁滞后"。

研究团队以工厂流水线为喻解释这一现象:工人每完成八个零件才能向调度室汇报进度,而调度室需在工人未汇报前指挥后续操作,只能依赖上一批零件的完成情况,对当前进度一无所知。补丁越大,信息滞后越严重,模型预测质量越差;补丁越小,质量提升但效率下降。这一矛盾长期制约字节级模型的发展。

SP方法的核心在于允许模型在补丁内部"边处理边记录临时草稿"。与传统模型仅在补丁结束时生成最终状态不同,SP在补丁处理过程中根据需要插入临时草稿,供后续字节预测参考。这些草稿仅用于当前计算,不存入模型记忆缓存,因此不会增加内存占用。实验表明,SP可显著缓解信息滞后问题,使模型在预测时依赖的"最新汇报"从上一个补丁的旧信息,变为当前补丁内最近的草稿更新。

为优化计算效率,SP采用基于预测熵的动态触发机制:当模型对下一个字节的预测不确定度高(高熵)时,生成草稿;不确定度低(低熵)时则跳过。这一策略确保计算资源集中于信息密集区域,避免无差别生成草稿导致的效率损失。研究团队设计的注意力掩码进一步保证草稿与正式补丁状态互不干扰,训练时通过并行计算草稿状态,不增加时间成本;推理时仅保留正式补丁,内存占用与普通补丁模型持平。

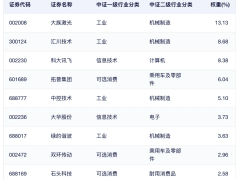

实验在统一框架下对比了多种模型的表现,包括纯字节级模型、传统分词器模型及四种补丁方法家族(固定大小分块、SpaceByte分块、基于熵的分块、H-Net分块),每个家族均测试了加SP与不加SP的版本。结果显示,SP在所有补丁方法中均显著提升质量,且不增加内存开销。例如,固定大小16字节补丁的模型加SP后,自然语言理解任务准确率从48.0%跃升至54.2%,接近纯字节级模型的54.1%,同时KV缓存仍小16倍,计算量减少3至4倍。代码生成任务中,SP的收益更为突出:固定大小8字节补丁的模型在MBPP测试集上的通过率从24.1%提升至32.1%,Humaneval测试集从13.0%提升至15.9%。

进一步分析表明,SP的提升并非单纯源于计算量增加。在等算力对比实验中,SP模型在相同训练浮点运算量下,验证集每字节比特数(BPB)均达到或优于非SP基准,证明其通过精准分配计算资源实现了效率与质量的双赢。唯一例外是H-Net分块,SP在等算力比较中轻微拖累BPB,研究团队认为这可能源于H-Net的学习型补丁边界与SP的熵触发机制存在位置偏移耦合,导致重复计算。

多语言测试显示,SP可缩小模型对非英语语言的性能差距。在FLORES-200数据集的200种语言评估中,加SP的补丁模型排名显著提升,与纯字节级模型的差距明显缩小,而传统分词器模型因依赖英语训练语料,在小语种上表现垫底。这一结果验证了SP的跨语言普适性。

SP的另一优势是推理时的灵活性。传统补丁模型的补丁大小和效率在训练时固定,部署后无法调整;SP模型则可在推理时动态调节补丁大小或草稿频率,无需重新训练。例如,调整熵触发阈值可控制草稿密度:提高阈值减少草稿,提升速度但轻微降低质量;降低阈值增加草稿,提升质量但增加计算量。这种调节为不同部署场景提供了灵活的质量-效率权衡空间。

尽管SP已取得显著进展,研究团队仍指出其局限性:训练阶段引入的草稿状态会增加一定计算量,未来需探索训练期节省算力的设计;当前草稿机制为简单的增量更新,未来可借鉴循环神经网络思路优化更新规则;SP在多层级补丁架构中的系统性研究尚属空白;与H-Net的兼容性问题也需进一步解决。