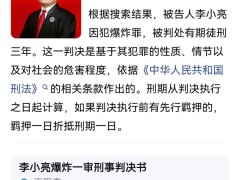

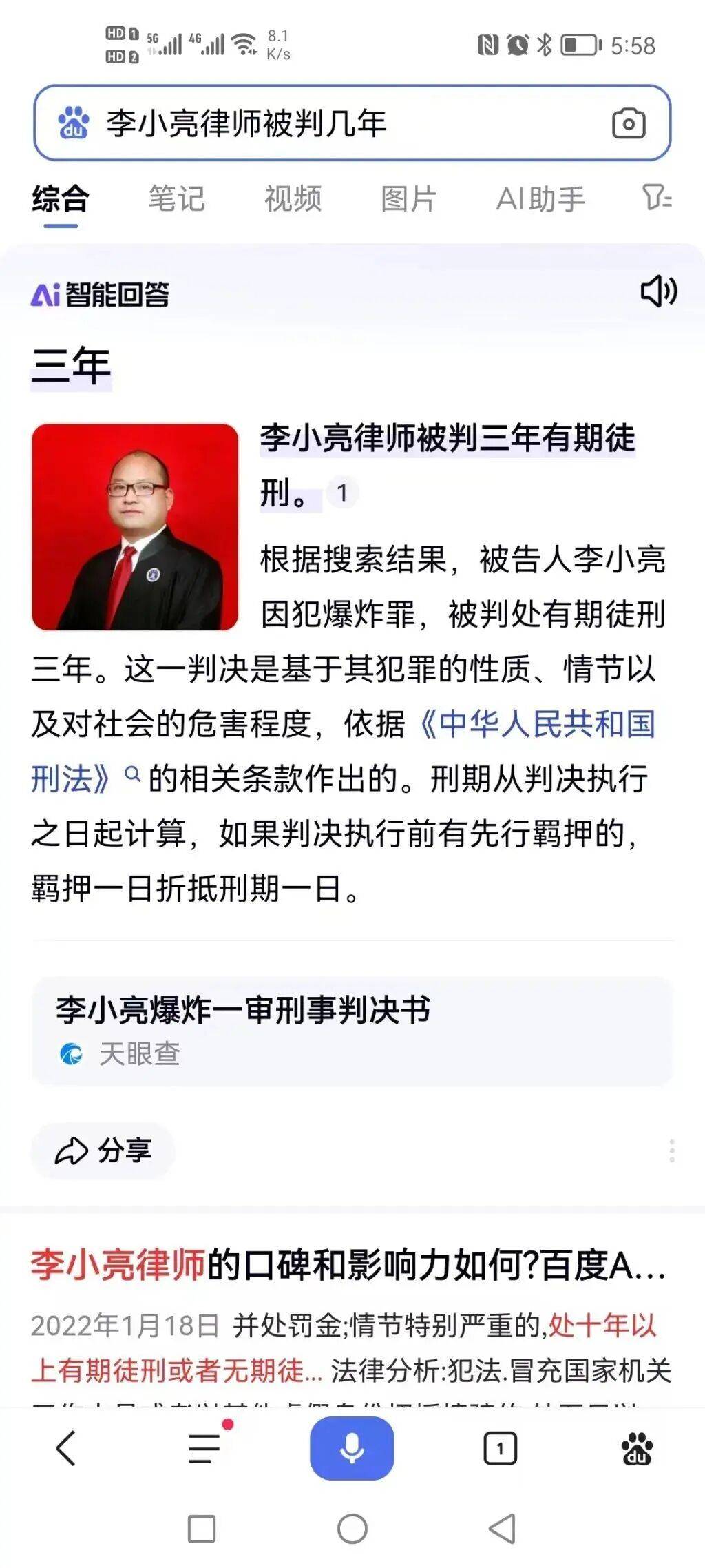

近日,一起涉及人工智能生成虚假信息的名誉侵权案件引发社会关注。南京市中级人民法院二审维持原判,认定某知名搜索引擎公司构成名誉侵权,需向当事人李律师书面道歉。该判决源于平台AI智能回答功能在用户搜索时自动生成不实信息,将原告与刑事犯罪关联并配发职业形象照片。

据公开报道显示,当用户在搜索框输入"李小亮律师被判几年"时,平台AI生成内容称"被告人李小亮因犯爆炸罪被判处有期徒刑三年",并展示其身穿律师袍的证件照。这种文字与肖像的双重绑定,直接导致公众对当事人职业操守产生质疑,对其个人名誉造成实质性损害。法院审理认为,平台作为技术提供方,对生成内容负有审核义务。

该案核心争议聚焦于平台责任认定。被告方提出三项抗辩理由:其一,AI技术存在不可预见的"幻觉"现象;其二,用户提问存在诱导性;其三,作为国内首例AI大模型侵权案,严格追责可能阻碍产业创新。但法院审理指出,平台既享受AI技术带来的商业利益,就应当承担相应的法律责任,不能以技术不可控为由逃避审核义务。

针对诱导性提问的辩解,法院查明原告系通过平台推荐词进入搜索页面,且AI生成内容的质量取决于算法设计、数据训练等核心环节。被告方承认"收到投诉后可修正错误词条"的表述,恰恰证明平台具备内容干预能力。将责任归咎于用户输入,实质是混淆责任主体。

值得关注的是,判决未支持原告提出的赔偿诉求。法律界人士分析认为,这种审慎态度有助于防止恶意索赔行为。随着AI技术广泛应用,若赔偿标准过低,可能催生通过污染训练数据制造虚假信息牟利的灰色产业链,这对技术健康发展将构成更大威胁。

该案判决明确划定AI产业法律边界:技术中立不能成为免责盾牌,运营主体始终是责任承担方。当AI深度介入公共信息传播领域,平台必须建立更严格的内容审核机制。技术创新必须以尊重他人合法权益为前提,只有守住法律伦理底线,才能实现可持续发展。